上周,OpenAI 超级对齐(Superalignment)团队的两位联合领导人–前首席科学家 Ilya Sutskever和 Jan Leike 双双在数小时内宣布从公司辞职。

此后,美国《连线》杂志报道称,在两位联合负责人离职后,OpenAI 的超级对齐团队据说已经解散。

团队的一位知情人士透露,OpenAI 曾承诺超级对齐团队可以使用公司 20% 的计算资源。但事实却是,尽管他们只申请了其中一小部分计算资源,也会经常遭到拒绝,从而导致团队工作无法开展。

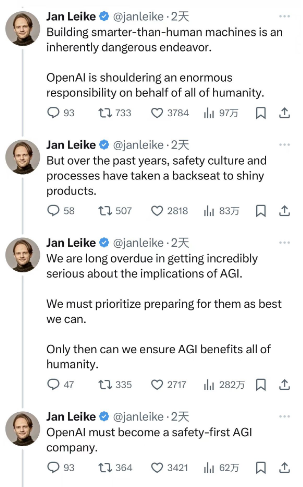

紧接着,Leike 在个人 X 账户上发布了一长串信息,公开阐述了辞职的一些原因。

“相当长一段时间以来,我一直与 OpenAI 领导层关于公司核心优先事项的意见存在分歧,直到我们最终达到了一个爆发点。

我认为,我们应该把更多的精力用于为下一代模型做好准备,包括安全性、监控、准备、安全、对抗鲁棒性、(超级)一致性、保密性、社会影响以及相关主题。这些问题都很难解决,我担心我们还没有步入正轨。

在过去的几个月里,我的团队一直在逆风航行。有时,我们为计算而苦苦挣扎,要完成这项至关重要的研究越来越难。”

他谴责 OpenAI 及其领导层在过去的几年里已经逐渐忽视了“安全性”,更加关注所谓的“shinyproducts”。

并强调,为了确保 AGl 能够造福全人类,我们必须认真对待 AGl 的影响,尽可能优先的做好准备。“OpenAl 必须成为一家安全第一的 AGl 公司。”

在 Leike 发帖数小时后,OpenAI 首席执行官 Altman 转帖回应表达了对 Leike 所做贡献的感谢。并表示,“他说得没错,我们还有很多事情要做;我们致力于完成这些工作。在接下来的几天里,我将会发布一篇更长的帖子。”

未经允许不得转载:岩猫星空网 » OpenAI 前超级对齐领导人抨击公司忽视安全治理

岩猫星空网

岩猫星空网